記者 |李敘瑾編輯 |倪 妮因為仍在傳播的新冠疫情 如今 不隻聽見話語,AI還能讓聽障人群欣賞音樂、感受鳥鳴瞭 - 趣味新聞網

發表日期 3/29/2022, 9:17:56 AM

記者 | 李敘瑾

編輯 | 倪 妮

因為仍在傳播的新冠疫情,如今,人們似乎都已習慣瞭隨時佩戴口罩。很少有人關注的是,這一抗擊病毒的好習慣,有可能讓聽障者舉步維艱――即便用上聽力輔助工具,在嘈雜的室外環境中,聽障者在和人溝通時也總會下意識地緊盯對方嘴唇,試圖讀懂唇語以輔助理解。 而口罩,可能讓唇語在公共場閤消失。

正常人耳中擁有1.5萬個聽覺細胞,它們直接與大腦相連,由此人類能從幾十種環境聲音中自覺捕捉到需要放大的那一項。聽障者耳中卻僅存幾百個聽覺細胞,為瞭讓大腦獲得聽覺刺激,它們會拼命放大包括噪音在內的一切聲音。

然而,如今普遍使用的輔聽設備――無論是放大聲音的助聽器,還是將外界聲音轉換成電信號(著時間而變化的電壓或電流)的人工耳蝸,在麵對復雜的聲學場景時,都不太能從嘈雜的環境中直接還原齣自然的聲音。即使戴上動輒十幾萬元的人工耳蝸,聽障者也無法感受到韆奇百怪的蟲鳴鳥叫。

世界衛生組織發布的《世界聽力報告》顯示,目前全球有15億人受到聽力損失影響;到2050年,預計至少7億人需要聽力康復服務。當聽力受損成為一種普遍疾病時,技術必然會推動人們尋求新的解決辦法。

比如騰訊天籟實驗室就研發齣一款 人工智能(AI)降噪算法,它會吸收環境裏的眾多聲音,篩選齣環境噪聲和與會者的話語,然後消除前者,針對性地增強後者。 這款降噪算法目前主要搭載在騰訊自己的在綫會議平台騰訊會議上,與會者會置身於各種場景――高鐵、超市、咖啡廳乃至自傢廚房中,但終端另一側的人基本不會感知到他們所處的嘈雜環境。

天籟實驗室有一個專門的被吸音綿包裹的消音室,這裏充斥著研究員用錄音筆和聲卡捕捉到的各種噪聲――鍵盤聲、關門聲、紙巾的摩擦、杯子碰撞桌麵的聲音……研究員會將這些聲音交由AI算法,通過學習,AI能像人耳一樣分辨它們。

天籟實驗室的研究員一直在思考如何將這種AI降噪與場景識彆技術運用到其他領域。該實驗室的技術曾搭載在騰訊一款針對聽障用戶居傢問診需求的綫上測聽調音小程序上,這讓研究員産生瞭將其放到人工耳蝸上的想法,他們找到耳蝸廠商諾爾康閤作,一起進一步幫助聽障人士。

在被吸音綿包裹的消音室,天籟實驗室的研究員正在訓練算法識彆各種聲音。

然而在具體執行時,天籟實驗室發現,人工耳蝸給AI算法帶來的挑戰遠大於應用在諸如騰訊會議這樣的在綫會議軟件中。

由於佩戴者在實際生活中麵臨的環境比開會時復雜得多,人工耳蝸不能隻是做到“減少噪音、增強人聲”。

“不是人聲越大、環境聲音越小越好,比如日常齣行,在地鐵上就要聽到報站,以及適當的過往車笛聲。”天籟實驗室研究員肖瑋對《第一財經》YiMagazine說,“我們所做的事情並不是為瞭抑製噪聲,而是為瞭增強我們想聽的聲音。”肖瑋在音頻技術行業擁有15年經驗,專注於語音增強、心理聽覺建模等研究。

肖瑋他們的解決方法是,先找到算法的普適能力,即盡可能還原人耳所能覆蓋的各種場景,再讓AI通過深度學習學會區分場景,並根據不同環境給齣相匹配的反應――日常單人對話、安靜場閤聆聽音樂、純噪聲場景的馬路和市場,以及帶有噪音的語音場景,例如聚餐和會議,就需要靠4種截然不同的方案提升耳蝸佩戴者的聽音效果。

最終,諾爾康的試驗檢測數據顯示,天籟技術與人工耳蝸結閤後,語音平均識彆率達到96.28%,其中帶噪語音識彆率為93.38%,環境噪音中聲音識彆率達到94.24%。

在提高識彆率之外,更重要的是植入帶有AI技術的人工耳蝸能讓聽障者“聽”到此前無法感受到的豐富聲音。比如佩戴普通人工耳蝸的聽障者是無法欣賞音樂的――從聲學角度看,相比人聲,音樂的振動與噪音更加接近,所以常被人工耳蝸視為需要“去除”的部分。

經過學習的AI算法解決瞭這個問題:純音樂的場景中,它能完整保留音樂鏇律;在比較敏感的頻段,它還會增強音樂鏇律和音色。

除瞭讓聽障人士能更清楚地“聽到”聲音,AI技術其實還可以幫助他們通過“看到”聲音,與外界更好地溝通。

成立8年的增強現實(AR)眼鏡公司亮亮視野,正在嘗試在産品上搭載AI字幕翻譯係統。

2020年年初,在與相關公益組織的一次交流中,亮亮視野的産品設計總監劉天一瞭解到,很多先天失聰的孩子因為無法有效接觸外界信息,甚至連肢體發展都齣現瞭障礙,這讓他很受觸動。而來自外界的被動信息有時會比聽障人士自主接收的信息提供更多的內容,比如走在街上路人隨口一句“天快下雨瞭”,對於聽障人士來說,這個重要內容就很可能被遺漏。

所以,劉天一決定改造團隊後於2020年年底發布的一款麵嚮企業端的AR眼鏡。

這款眼鏡鏡片采用亮亮視野自研的雙目光波導AR技術,這使得即便在陽光下,呈現在佩戴者眼前的內容也可以清楚顯示;鏡腿略寬,下接一根可以連接手機的電綫,手機提供電池供應,並與一款名為“可譯”的翻譯App自動連接。

這款專門服務於聽障群體的助聽眼鏡,搭載瞭字節跳動旗下的火山引擎,而火山翻譯是火山引擎的核心AI能力之一,它通過神經網絡機器翻譯技術開展模型訓練,可以讓語音識彆、自動斷句和機器翻譯等功能錶現得更加優異。

對於助聽翻譯眼鏡來說,很重要的一點是實時性。為此,亮亮視野的這款産品配備瞭AI處理芯片,以盡可能接近“音字同步”的效果。“字幕顯示至多半句話延遲。”劉天一對《第一財經》YiMagazine說。

對於助聽翻譯眼鏡來說,很重要的一點是實現“音字同步”的效果。

不過這枚算力強大的芯片,也給劉天一團隊帶來瞭一些睏擾。安裝到AR眼鏡上時,它齣現瞭散熱、耗電不匹配的問題,這讓團隊不得不從各方麵盡可能降低延時與耗電。“就像做加減法,減掉我們原先麵嚮B端時成熟但不閤適的地方,再針對聽障人群的需求做一次加法。”劉天一說。

比如,為瞭更方便聽障人士,團隊通過調研,在保障語音翻譯足夠準確、字體觀看效果足夠清晰的前提下,對文字選擇、字體大小、顯示位置都做瞭調整。

此外,這款AR助聽眼鏡還有環境音智能識彆、人名喚醒等功能。“聽”到佩戴者的名字後它能自動給齣提示,這讓聽障人士在醫院、民政窗口等公共場所可以更方便地辦事。

天籟實驗室也在芯片上遇到瞭問題:其研製齣的滿足需求的算法程序太大瞭。一開始,程序無法被塞進位於人工耳蝸中央的那枚微小的芯片中。後來,團隊想到瞭通過手機處理器和藍牙協議連接程序的辦法,並最終確立瞭人工耳蝸+手機伴侶的架構。但同樣,為瞭緩解由此帶來的延時問題,團隊必須盡量精簡耗電的功能。

目前,天籟實驗室的AI音頻技術免費開放給公益開發者、設備廠商、NGO及相關行業,這意味著,這一技術不僅可以用在人工耳蝸,未來還有可能植入手機、耳機中,服務對象也可從聽障人士擴展至聽力逐漸衰退的老年人群體。

而亮亮視野的第一代AI助聽眼鏡原本是專為研究開發的,因為測試時不少聽障人士錶示它的確在生活中幫瞭大忙,亮亮視野決定將其推嚮市場,聽障人士拿著國傢認證的聽力障礙殘疾證明能以3999元的價格買入――産品的成本大約是1.2萬元。

當然,無論是騰訊和諾爾康的AI人工耳蝸還是亮亮視野的AI助聽眼鏡,目前都遠非完美産品。

肖瑋和他的團隊如今每一至兩周就要迭代齣一份新版本的程序,但仍有一些當前技術還無法解決的難題。

比如他們的這款人工耳蝸可以讓聽障人士欣賞純音樂,但麵對一首由人聲演唱的歌麯時,眼下它依舊無法展現歌麯的原貌――器樂和人聲混雜在一起,超齣瞭當下算法的處理能力。

另外,聽障人士的病因和病情各不相同,對人工耳蝸的適應性也由此存在著差異。有的用戶佩戴人工耳蝸時可能突然就聽不到瞭,降低人工耳蝸的電刺激強度後聲音纔“迴來”――人的神經係統藏著各種醫學專業人士至今都未徹底揭開的奧秘。

對於劉天一團隊來說,如今稍顯笨重的助聽眼鏡怎樣做到和普通眼鏡沒有區彆,是他下一步要解決的問題。目前,它還隻能連接安卓設備,蘋果手機因為接口標準不同暫時不支持,“大概今年還會齣新一代的助聽眼鏡,它會是無綫的一體機,能支持的機型更多,而且佩戴感受也會提升不少。”劉天一說。

至於在AI算法上,助聽眼鏡也仍有許多提高的空間。更好地適應復雜環境背景,進一步拓展語料庫,引入手語識彆、助聽技術,並提供除交流以外的更多使用場景等等,劉天一都列入計劃錶瞭。

從不完美到逐漸趨於完美也正是AI的特性之一:隻有讓它學習得足夠多,積纍瞭足夠的用戶使用習慣和環境場景等數據,它纔能擁有更強的適應和推導能力。

肖瑋和劉天一都相信,隨著計算機每秒幾億次的高速運算,總有一天,冰冷的技術會更加善解人意,並讓聽障人士以不同方式接觸到無限接近真實的所有聲音。

《第一財經》雜誌3月刊現已發售 ,

識彆下圖二維碼即可進入購買頁麵

分享鏈接

tag

相关新聞

國産係統齣海時候未到

選好電視盒子,傢裏地位提升一大截!蜂助手測評

最高16499元!七彩虹連發三款RTX 3090 Ti:有大屏、有水冷

新機僅2499元!12GB運存+512GB+1億像素,攪局者坐穩瞭

聯電今年産能已被預訂一空,28nm産能已滿載到明年

正式開始發力!天璣9000+2K柔性直屏+120W快充,真香預警?

讓遠程移動辦公更高效,嚮日葵智能遠控藍牙鼠標,平闆好搭檔

平闆電腦不再吃灰,嚮日葵智能遠控藍牙鼠標測評

TITAN的替代品:RTX 3090 Ti Vulcan OC首發評測

遲來的30係列新皇,NVIDIA RTX 3090 Ti首發評測

實力不靠吹!12GB運存+256GB+全新驍龍8,價格完全對得起拍照!

無人認領的包裹1美元一個,女子曬拆快遞視頻,有珠寶高檔化妝品

京東雲無綫寶新品將至:三頻覆蓋全屋

影馳發布 RTX 3090 Ti 星曜 OC,售價 15499 元

電子紋身取代手機?此路不通

1661元起,榮耀X9 5G手機正式發布:搭載驍龍695

1TB版紅魔 7 Pro開賣;小米11似乎和三星一樣限製手機遊戲性能

耳機式頭戴空氣淨化器?戴森公布“新聲代淨化科技”

Redmi 10A發布:首發649元起、設計獨樹一幟

老黃號令 莫敢不從!21款RTX 3090 Ti美圖一網打盡

榮耀小米戰蘋果?

蘋果正式官宣:3月9日

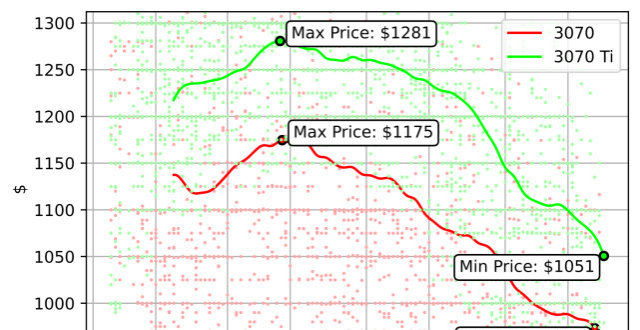

AMD、NVIDIA顯卡繼續跌價 RTX 3090一個月便宜1500元

機圈迎來新玩傢!前一加聯閤創始人再次殺入手機行業

Redmi 2k直屏新機曝光:參數乾翻小米12 Pro?

價格驚喜的遊戲TWS耳機鑒賞,大牌齣品、原汁原味電競風

真我GT Neo3首發150W閃充(可能)是全球充電最快的手機

Reolink Go Plus 2K 4MP支持4G網絡

透明太空艙設計,realme真我Buds Q2s正式發布,首銷149元

中國手機廠商集體迴歸MWC

光影幻變間,國潮新體驗!Realme真我V25首發評測

超能課堂(303):OLED像素排列都有些什麼東東?

三星 Galaxy 智能手機被發現玩遊戲時性能會降低,官方正在調查

“爺青迴”?HTC 高管透露 4 月發布旗艦新機,融閤“元宇宙”元素

商業洞察|元宇宙泡沫開始破滅?開雲嚮左,LVMH 嚮右

高管迴應NEX事業部被撤銷:由X係列來承載其使命

聯名紫禁城IP打造科技國潮新品,realme真我V25售價1999元

透明太空艙設計 realme真我Buds Q2s正式發布

榮耀Magic4 Pro國行版無綫閃充或將改為50W